Опасно ли использовать Perplexity AI

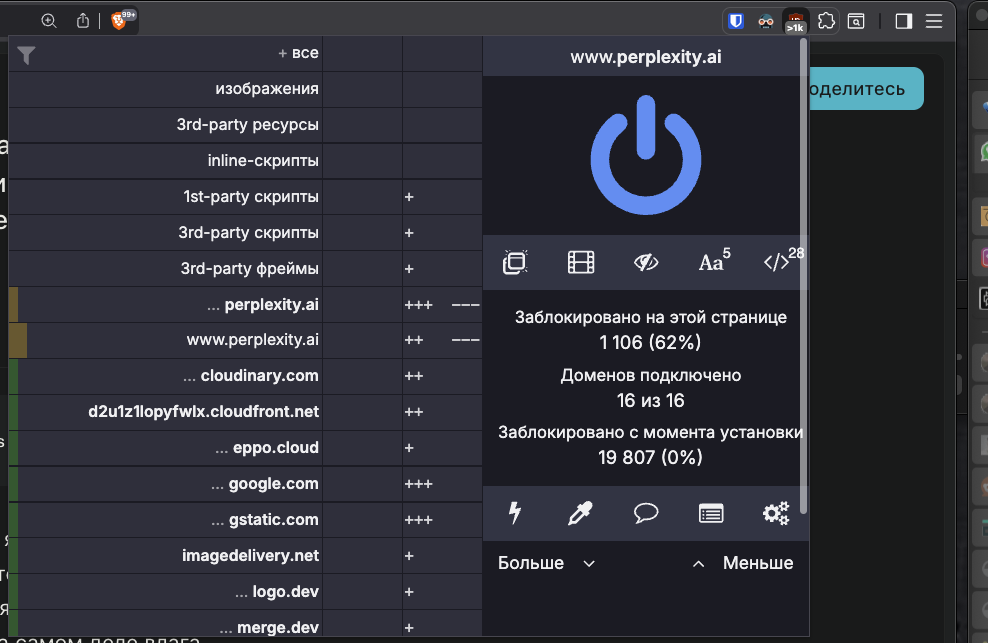

В комментариях к обсуждению подписки на Perplexity AI высказали предположение, что этот сервис может хранить вашу переписку с различными моделями AI. Насколько я знаю, практически все AI хранят эту переписку и могут отправлять на проверку то, что они считают опасным.

Но я задал вопрос ChatGPT по поводу того, какие опасности могут быть при использовании Perplexity AI.

Потом задал данный вопрос в самой Perplexity AI. Получил ответ, очень мало отличающийся от ответа ChatGPT. Кстати, если спросить об опасностях при использовании ChatGPT, то ответ будет очень похожим, и его тоже привожу ниже.

Использование Perplexity AI связано с определёнными рисками для безопасности и конфиденциальности, которые неоднократно отмечались экспертами и в СМИ по состоянию на сентябрь 2025 года.gerki+5

Основные угрозы безопасности

Уязвимости приложений

В Android-версии Perplexity AI найден ряд серьёзных уязвимостей: открытые ключи API, отсутствие базовой SSL-фиксации (защиты трафика), возможность межсайтовых атак и небезопасная организация интерфейса API позволяют атакующим похищать учётные данные и персональные сведения, а также создавать поддельные версии приложения.uscsinstitute+1Отсутствие сквозного шифрования

Данные пользователя (вопросы, история поиска, IP-адреса, информация об устройстве) собираются для улучшения моделей, но компания не реализует по умолчанию сквозное шифрование, что повышает риски утечки данных или их перехвата третьими лицами.pcmatic+2Новая браузерная версия и поведенческий трекинг

В 2025 году Perplexity представила браузер с ИИ, интегрирующий сбор данных по всему интернет-серфингу пользователя, что делает платформу частью новой волны «surveillance capitalism» — экономики наблюдения. Такой браузер отслеживает каждую вкладку и клик пользователя.secureitworld+1Проблемы конфиденциальности

Хранение личных данных и их использование

Компания имеет не очень прозрачную политику хранения и использования пользовательских данных, что вызывает обеспокоенность по поводу возможного доступа государственных и частных организаций к содержанию переписки и запросов пользователей.industrywired+1Риски, связанные с загрузкой файлов

Не рекомендуется загружать в Perplexity конфиденциальные документы и изображения: обработка происходит на внешних серверах с потенциальной возможностью утечки или доступа третьих лиц.reddit+1Риск атак через внедрение вредоносных инструкций

Известен класс уязвимостей типа prompt injection, когда злоумышленник может заставить ИИ-платформу выполнить несанкционированные действия или раскрыть приватную информацию.secureitworld+1Рекомендации по безопасности

Не вводить в Perplexity AI личную, конфиденциальную или финансовую информацию.internetmatters+1

Не загружать чувствительные файлы и изображения.reddit+1

Использовать VPN и максимально ограничивать права доступа приложения.pcmatic

Следить за обновлениями приложений и не использовать альтернативные версии вне официальных источников.gerki+1

Вывод

Perplexity AI полезен и функционален, но в ряде реализаций и сценариев применения по состоянию на 2025 год содержит критические недостатки в защите данных и может подвергать пользователей риску утечки приватной информации, кражи учётных данных и мониторинга действий в Интернете.

А теперь об опасностях при использовании ChatGPT.

Использование ChatGPT (https://chatgpt.com/) в целом считается безопасным, но связано с некоторыми рисками для безопасности и приватности, о которых важно знать пользователям.kaspersky+6

Основные риски безопасности

Передача и хранение личных данных

Вся введенная информация (вопросы, файлы) и технические данные (IP-адрес, устройство) сохраняются на серверах OpenAI и могут использоваться для обучения моделей или внутренней аналитики, а также передаваться субподрядчикам и по запросу государственных органов.privateinternetaccess+3Утечки и хищение данных

Если в сервис случайно введены конфиденциальные сведения (например, логины, пароли, коммерческая тайна), они могут быть похищены злоумышленниками в случае взлома, утечки или неправильной настройки безопасности на стороне OpenAI. В 2023 году был зарегистрирован инцидент, когда произошла утечка заголовков чатов и информации о платеже у части пользователей.lifelock.norton+1youtubeФишинг и социальная инженерия

Модель может быть использована для генерации весьма убедительных фишинговых писем и сообщений, облегчая работу киберпреступников.malwarebytes+1Использование для разработки вредоносных программ

ChatGPT способен помочь злоумышленникам в написании вредоносного кода, что отмечено в ряде исследований.malwarebytesРаспространение дезинформации

Сервис может непреднамеренно генерировать ложные факты или недостоверную информацию, на основании которой принимаются ошибочные решения.layerxsecurity+1Меры, предпринимаемые OpenAI

Протоколы шифрования для защиты данных при передаче и хранении.surfshark+1

Регулярные аудиты и программы поиска уязвимостей.security+1

Контроль доступа, многоуровневая аутентификация и фильтрация контента.layerxsecurity+1

Соответствие требованиям GDPR и других международных норм по защите данных.surfshark+1

Рекомендации по безопасному использованию

Не вводить в ChatGPT личную, финансовую или конфиденциальную информацию.keepersecurity+2

Использовать разные пароли для разных сервисов и включить двухфакторную аутентификацию.

Отключать функции памяти профиля, если не требуется сохранение контекста между сессиями.privateinternetaccess

Следить за обновлениями и быть внимательными к ссылкам, полученным через AI.

Вывод

ChatGPT оснащен современными средствами защиты, однако не гарантирует полной приватности, и существует риск утечки или некорректного использования личных данных, как и у любого крупного облачного сервиса. Важно относиться к чату как к открытому онлайн-ресурсу и избегать обсуждения тем, которые могут наносить ущерб безопасности личности или бизнеса.nordpass+6

Есть SSL как таковой (который уже давно TLS по факту) и есть SSL pinning. Речь именно про второе, которое, безусловно, найс ту хэв, но, все-таки.. Обычный HTTPs (TLS), конечно, используется, текстовых HTTP запросов вы сниффером не увидите.

Достаточно уже было случаев, которые показывают, что большинство компаний работает по принципу "Будем делать, пока нас не поймают за *опу, а потом заплатим мизерный (по сравнению с выручкой за проданные данные) штраф и дадим честное пионЭрское больше так не делать".

ОСОБЕННО это касается бесплатных сервисов, где вы не клиент, а "товар".

Меня всегда умиляет, когда в обсуждении того или иного продукта, или инструмента врывается кто-то, кто радостно кричит "а мне он не нужен". Ок, не нужен, и?

Сравнение тёплого и мягкого - умилило. Причём к ИИ поисковики и jstor? Вообще инструменты разного назначения. Поставить в один ряд - всё равно что сказать "я использую лопату и зубную щётку". Словно есть хоть один человек, который не пользуется гуглем, бингом или другим поисковиком.

Например я тоже не придумал зачем мне дома использовать LLM и агентов на постоянной основе.

Но как инструмент образовательный для работы с большим объёмом информации помогает. Мне. Лично. И не только мне

лопату уговариваешь накопать картошки, а она извиняется и копает клубни цикуты.

Но я пробую накидать источников которые мне интересны, книги, видео, ссылки и потом заставлять llm-ку из этих источников брать ответы

Где любой? Вот он."

Поисковики и ии ‐ зависимость прямая. Ии берет информацию хрен знает где и даёт хрен знает на чём основанный ответ.

Поисковик даёт ссылки, credibility которые можно определить самому, и на основе самых достоверных сделать нужный вывод и тд.

Сеть работающая на основе ассоциативных токенов всегда будет врать в той или иной степени. Она так устроена. Как тот робот у Азимова, который врал, чтобы не огорчать людей.

Сложные математические расчёты и все связанное с математикой им можно доверить. Но мне это уже давно не нужно. А даже простейшую электронную схему я бы не доверил.

Да, это мощный инструмент в определённых сферах. Но нужен ли отбойный молоток чтобы пробить отверстия для карниза для штор?

Для поиска и анализа информации - они же часто врут, если кто хочет сесть с этим в лужу - welcome.

Ремонтировать своё железо они тоже не имеют понятия как. А я имею. Поэтому и смотрю на них соответствующе.

Вот живой пример, человек так доверяет ии, что сам не может найти оригинальную историю на которой основана его байка.

Вы скоро все уползете в мир мифологем ии, и будете верить им больше чем книгам, учебникам и монографиям. Приятного путешествия в мир машинных грез.

И это только одно из многих несоответствий.

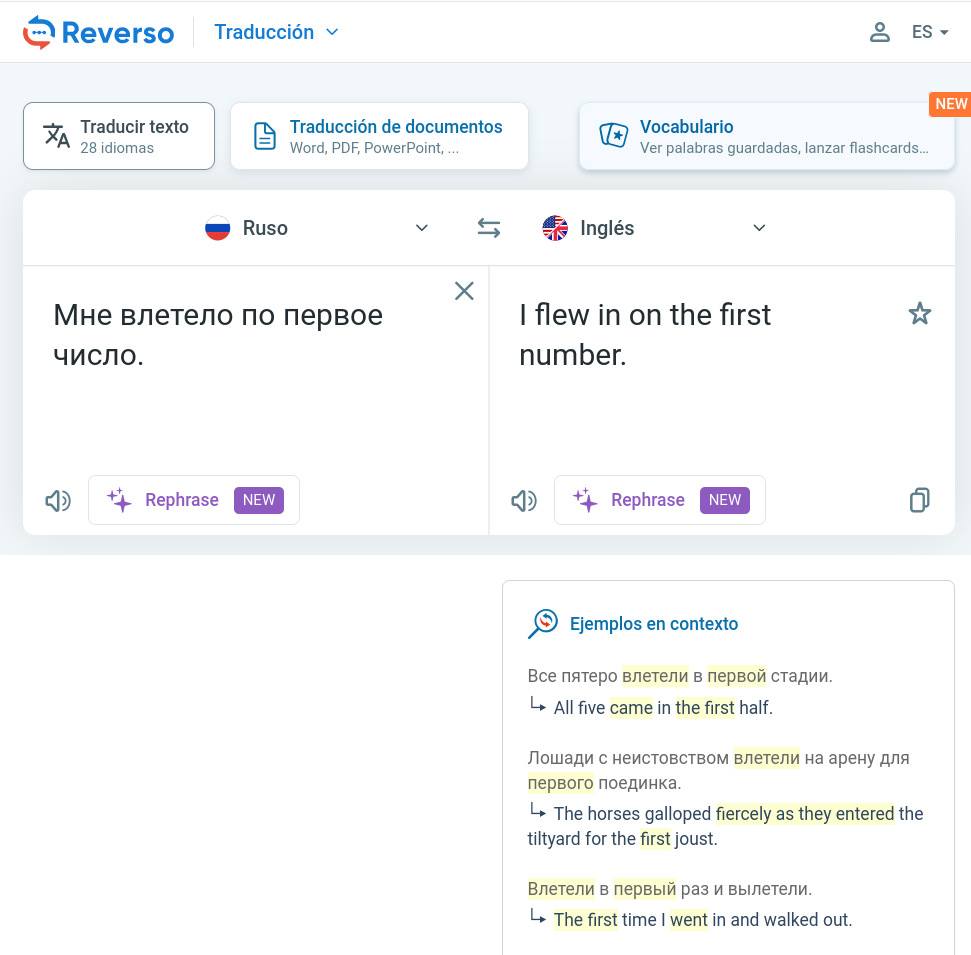

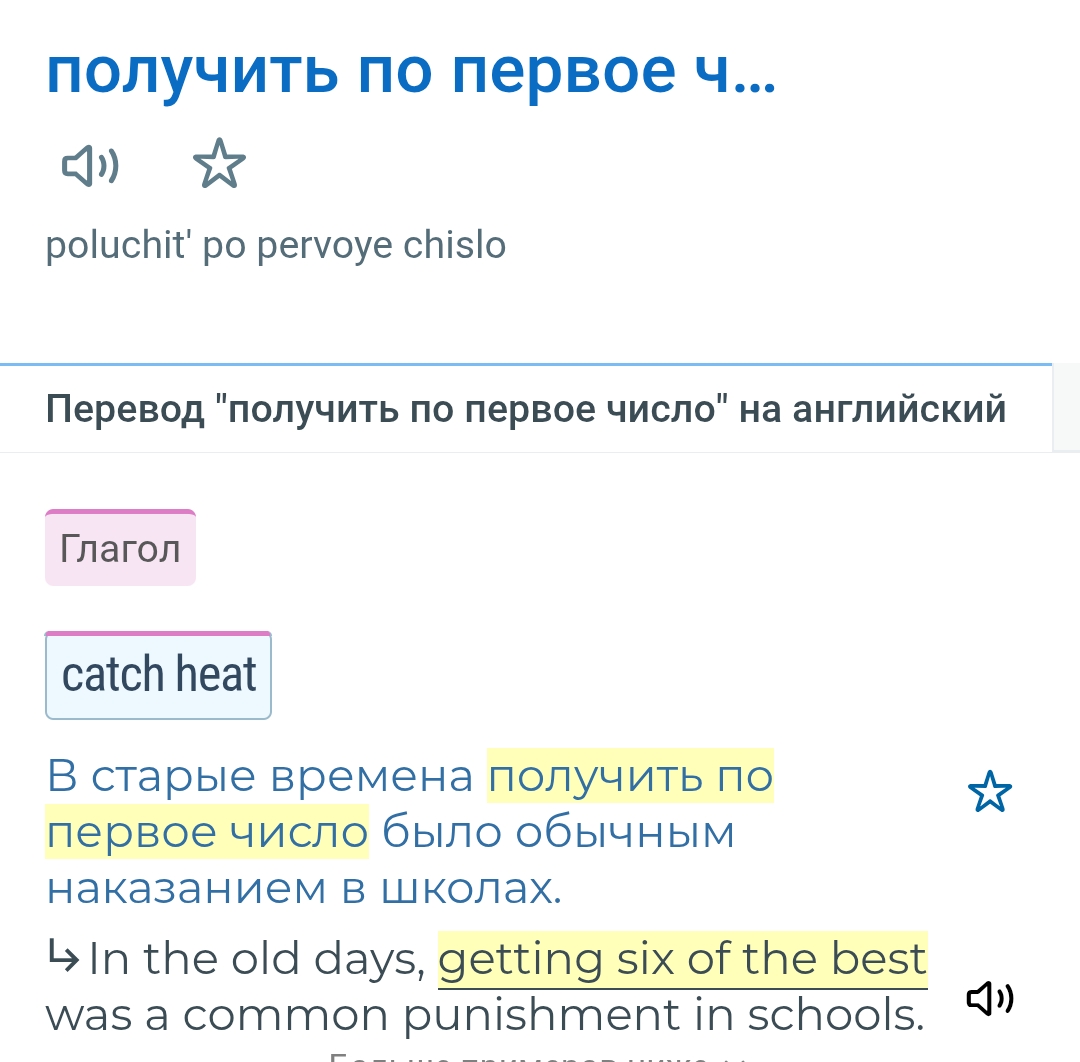

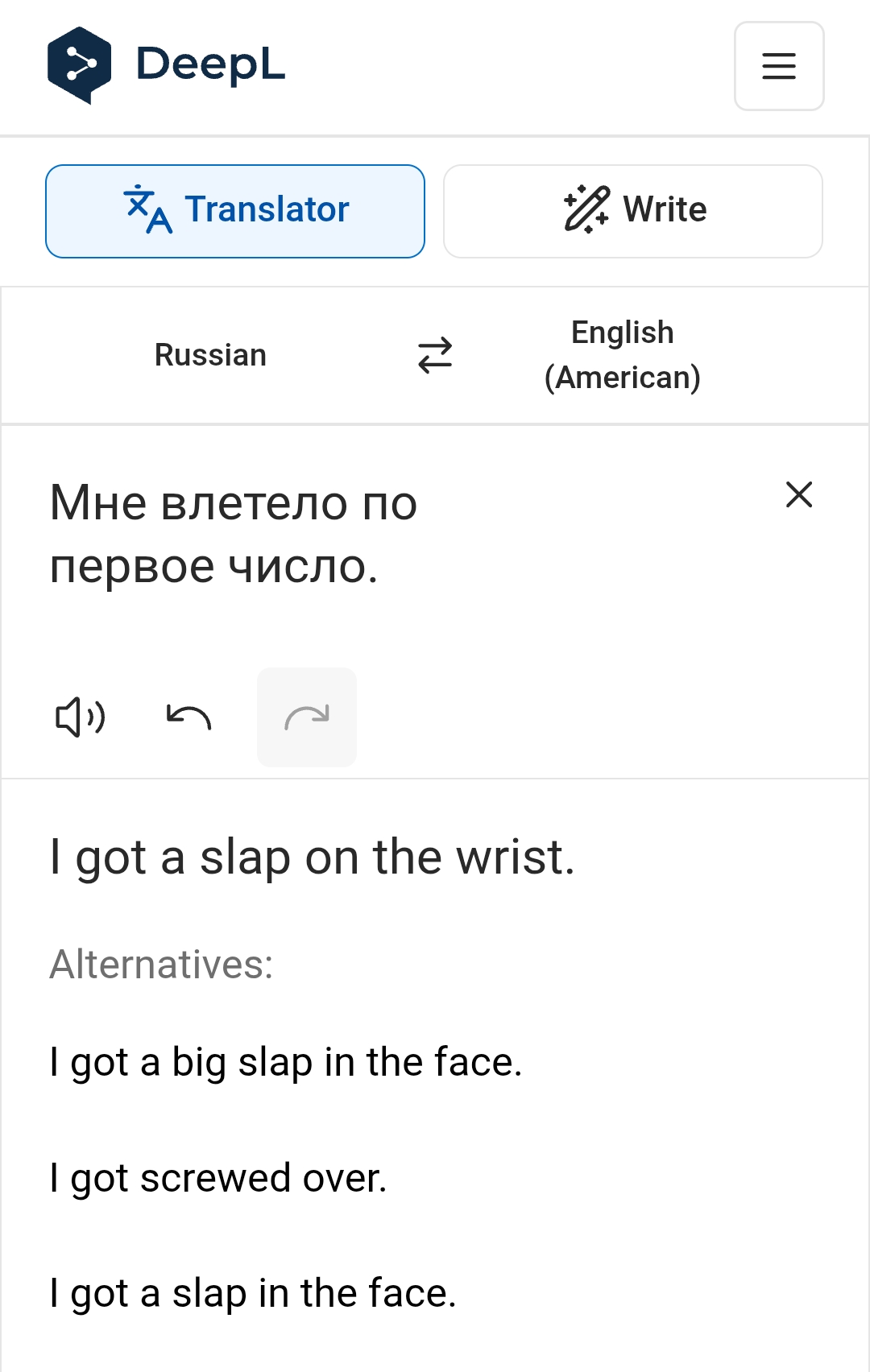

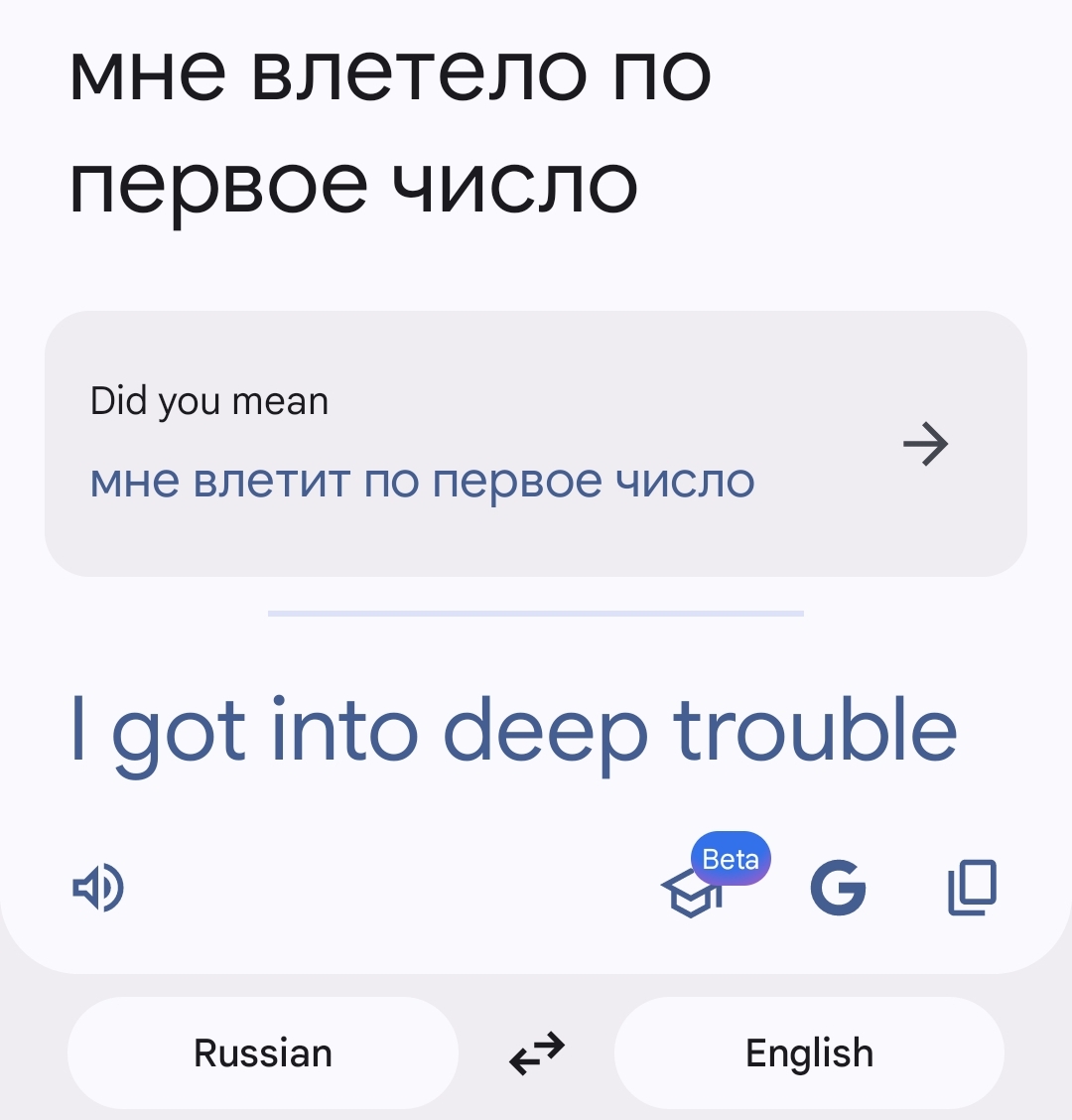

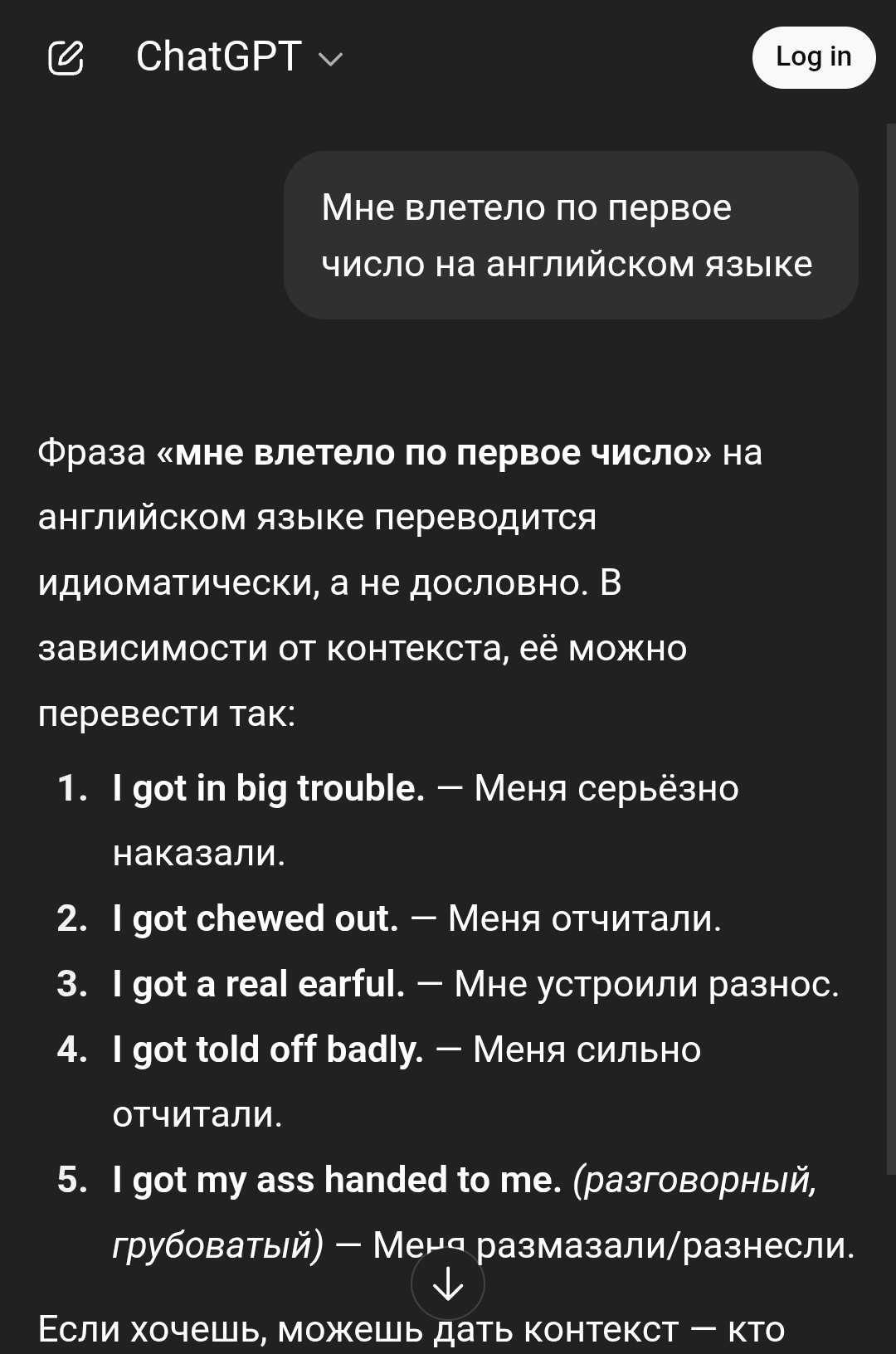

Потому что «I got into deep trouble» — это не про наказание, а про констатацию факта без настигших последствий. Для идиомы скорее подходит что-то из вариантов 2–4 на вашем скриншоте от GPT. Там как раз о том, что наказание (скорее вербальное) состоялось — и было таким, что запомнилось надолго, наперед, «по первое число». Чтобы в следующий раз «не повадно было» или даже мысли не возникло.

А у Реверсо просто констатация факта — «попал в беду» и всё. Без последствий и без «по первое число».

Но вообще-то, когда я выше просил пример, я почему-то ожидал от Вас фрагмент специализированного текста на английском, перевод которого Вы, как эксперт по специализированной теме, забраковали. А получилось, что там было про бытовую идиому с субъективным выбором.

Это не про неточность ИИ. Это про то, что «художник, так видит».

p.s.: как вариант, идиома была выбрана неудачно и Редактор ее вообще не переводил, а просто описал ситуацию своими словами, потому что был в курсе контекста. Поэтому, его выбор — это не столько оценка правильности перевода идиомы, сколько личная интерпретация события.

Я не знаю почему у других реверсо показывает got into deep trouble, это перевод гугла имеющий совсем другое значение. Getting six of the best предложенное реверсо работает гораздо лучше и более емко, чем расписывать или тем более чем "пощёчины" дипэль и "разносы" джипити.

В это все к тому, что художественный перевод тоже творчество, и никакой ии его в ближайшее столетие не осилит. Пока новые алгоритмы не придумают. А это будет ещё не скоро и на другой базе, квантовой или био.