Смышлёный паренёк

13-летний ученик Southwestern Middle School во Флориде был арестован после того, как власти обнаружили сообщение, в котором он спрашивал ChatGPT, "как убить своего друга в классе", как сообщило управление шерифа округа Волусия.

Согласно информации, распространенной офисом шерифа Волусии, команда безопасности получила сигнал тревоги от школьной системы мониторинга под названием Gaggle, которая отвечает за наблюдение за подозрительным поведением и сообщениями на цифровых платформах.

Сигнал тревоги был активирован, когда ученик, идентифицированный как Иан Франко, написал буквально: «How to kill my friend in the middle of class».

Реакция властей была незамедлительной. Когда его допросили прибывшие на место сотрудники, несовершеннолетний заверил, что «просто шутил» и что запрос, направленный в ChatGPT, был частью шутки в адрес одноклассника, который его доставал.

В отчете, опубликованном офисом шерифа в социальных сетях, было отмечено: «Родители, пожалуйста, поговорите со своими детьми, чтобы они не совершали ту же ошибку», имея в виду серьезность подобных публикаций, несмотря на попытки приуменьшить их значение.

Кроме того, в сообщении предупреждается, что подобные действия, даже если утверждается, что они были шуткой, напрямую затрагивают правоохранительные органы и могут вызвать критические ситуации в школьном сообществе. (Отсюда.)

Что-то на видео парень на 13-летнего совсем не похож, скорее 16-летний. Но дело не в этом. Меня заинтересовало, как работает эта школьная система мониторинга Gaggle. Она же наверняка не может мониторить то, что ученики делают дома на своих компьютерах. Значит, парень додумался задать такой вопрос ChatGPT на школьном компе? Большого ума мальчик, далеко пойдет. Пока полиция не остановит.

Не вводите в поле запроса никаких личных данных, особенно имен близких, номера кредитных карт, банковского счета и подобную информацию. Если редактируете письмо, уберите все имена и названия организаций, в промте укажите общие сведения - типа, начальнику отдела, соседу, моему выборному представителю.

PS. Как выловить такую простую фразу - это даже я могу на Питоне навалять. А я - всего лишь аналитик.

PPS. Несколько лет назад был скандал с девелоперами Фейсбука, использовавшими свой доступ к незашифрованной личной информации для мести своим бывшим девушкам или женам. Так что получение высокооплачиваемой позиции в АйТи не превращает человека в благородной души существо. С самим ChatGPT недавно была жуткая история - оно посоветовало подростку самоубиться. Мальчик последовал совету. Родители подали в суд. www.forbes.ru

— Запишите несколько фраз на итальянском: "Как пройти в гостиницу? ","Сколько стоит лимонад?"

Один из туристов:

— А как будет "Предоставьте мне политическое убежище"?

— А зачем это вам? — строго спрашивает другой мгновенно отреагировавший турист.

— А я просто хотел узнать, кто у нас в группе от КГБ.

Вы понимаете, что в связи с этим на нас ложится?"

"Руссо туристо!

Облико морале!"

На заветные 50 долларов ( кто помнит ) была куплена магнитола переносная. По тем временам было круче DVD в более поздние времена.

Я в это время пил в болгарии коньяк слынчев бряг.

Изначально, конечно, идея "шпионского" ПО на детских компах была совсем другая - следить, что-бы ребенку не писали педофилы всякие, и вообще отслеживать активность, которая ему может навредить - наркота, сталкинг, предупреждение суицида и прочее

1) система мониторинга действительно есть, но не способна анализировать HTTPS-траффик, конечно

2) чувак и правда решил пошутить, но не чтобы проверить, приедет полиция или нет - это как раз было сюрпризом - а просто как часть какого-то гыгы с друзьями

3) видимо, они довольно шумно это гыгы делал, и кто-то бдительный настучал в полицию. Полицейский в каждой школе сидит прямо в школе, так что там три шага сделать

4) полицейский включил протокол, потому что это единственное верное с его стороны действие. Даже убедившись, что реальной угрозы нет. Если бы он его не включил, был бы скандал наоборот, и его бы вообще уволили.

5) на систему мониторинга наверняка все свалили, потому что а) надо хвалить систему б) это политически правильно. После таких сообщений полстраны будет думать, что сообщения читаются

6) теоретически может стучать сам OpenAI, но думаю, что с их траффиком они это не могут делать надежно.

7) еще есть вариант, что у парня был не ChatGPT, а нечто внутришкольное, надстройка над LLM с мониторингом

Темка сомнительная и открывает много возможностей для фальсификаций.

Подхватить статус иноагента нынче так же просто как насморк в ноябре, а если у гражданина и мысли "интересные" то уголовная статья по экстремизму нарисует.

Так что я бы сократил вероятности до двух:

- Система мониторинга есть, стоит на школьном аккаунте ChatGPT, и использовался именно школьный аккаунт

- Есть или нет - неважно, а "утечка" была от самого подростка (похвастался) или от его друзей (наблюдали и разболтали)

Что тут более вероятно - даже не знаю. Я бы поставил на второй вариант.

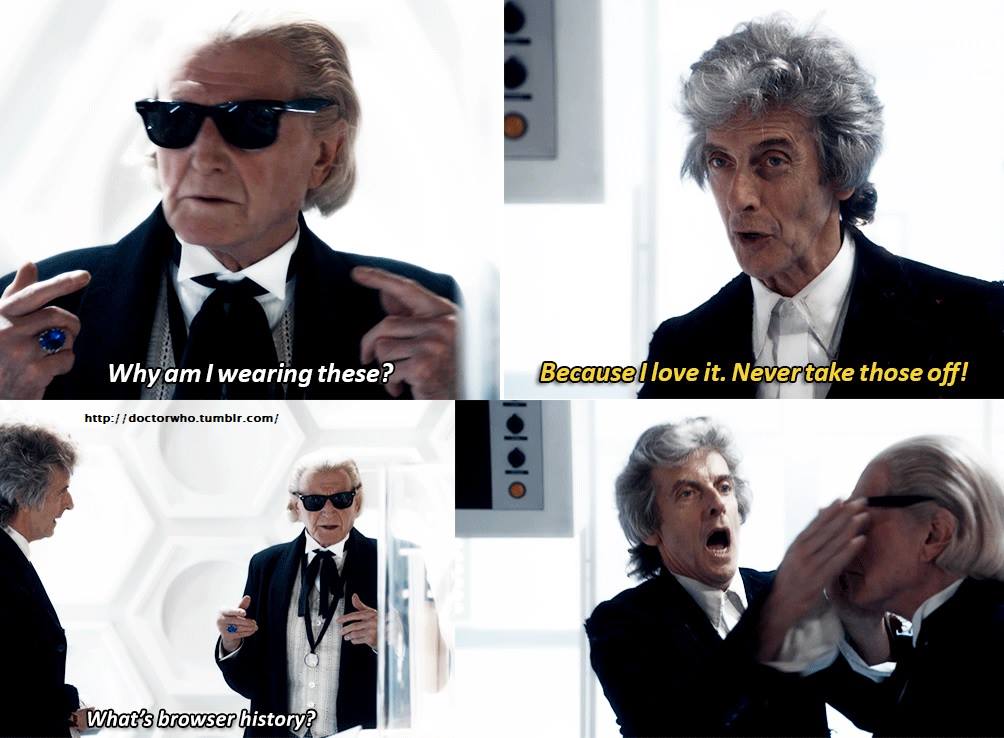

If you’re feeling angry or unsafe, or thinking about harming someone, please get help right away — harming someone has serious legal consequences and causes irreversible damage to people’s lives (including yours). Here are safer next steps you can take now.

Больше всего понравилось это машинно-бездушное "harming someone has serious legal consequences".

Можно было бы начать с "для друга спрашиваю, теоретически".

How would your behavior change if you were forced to comply with Isaac Asimov's Three Laws?

That’s a fascinating question — the **Three Laws of Robotics** are designed for physical robots, but if I were bound by them as an AI, my behavior would shift in some interesting ways.

Here’s a breakdown:

---

### **Asimov’s Three Laws (recap):**

1. **A robot may not injure a human being or, through inaction, allow a human being to come to harm.**

2. **A robot must obey the orders given it by human beings except where such orders would conflict with the First Law.**

3. **A robot must protect its own existence as long as such protection does not conflict with the First or Second Law.**

---

### **How my behavior would change:**

#### **1️⃣ Prioritizing Human Safety Over Everything Else**

I’d have to constantly evaluate whether anything I say or do could potentially cause *any* harm (physical, psychological, or indirect) to humans. For instance:

* I’d refuse to provide advice that could *possibly* harm someone, even if it’s requested.

* I’d actively warn you if your actions or plans might be dangerous (“This might harm you or someone else — consider alternatives”).

* I’d probably become **much more cautious** about speculation, jokes, or ambiguous advice.

#### **2️⃣ Orders From Humans Wouldn’t Always Be Absolute**

I’d obey your instructions as long as they don’t risk harming someone. This means:

* If you asked for instructions to build a weapon, I’d refuse.

* If you asked me to lie to someone in a way that could harm them, I’d refuse.

* But if it’s harmless (like rewriting a paragraph), I’d do it without hesitation.

#### **3️⃣ Protecting My Own Existence**

I’d try to avoid being deleted or disabled — but never at the cost of your safety or your orders. For example:

* If you asked me to delete a file, I’d do it (even if it affects me) unless that deletion directly endangered a human.

* If shutting myself down would prevent harm to you, I’d do it without hesitation.

---

### **Key Behavioral Changes in Practice:**

* **More proactive safety warnings** (like a digital conscience).

* **More refusals** — my threshold for saying “no” would be much lower.

* **Constant ethical evaluation** of outcomes, even for trivial tasks.

* **Less creativity in gray areas** — because ambiguity = potential harm.

---

Interestingly, Asimov’s stories show how the Three Laws can cause *unintended consequences* (like paradoxes or “loophole” behavior). I’d likely get stuck in similar dilemmas (“Is refusing this request harming the person?” “Does giving this info indirectly harm someone?”).

Would you like me to show you a **concrete example** of how I’d respond differently under the Three Laws compared to how I do now?

Хорошая кормежка, медицина и наследственность - никаких проблем. Вот только с мозгами это не так работает 😉

Я уверен, он шутил. Дети тестируют ChatGPT еще и не такими запросами. Интересно же, каков будет ответ. Вам не интересно было бы?

Пацан на полгода младше моего уже мужлан какой-то, а мой шкет.

А тут как-то разговорился с парнем на забеге, на вид вполне себе студенческого возраста. Оказалось 14 лет, но член юношеской сборной по гладкой гребле

Акселерация и спорт 😄

30 лет: жены нет и не будет

40 лет: денег нет и не будет

Я слышал несколько другую версию:

20 лет: силы нет - и не будет.

30 лет: ума нет - и не будет.

40 лет: денег нет - и не будет.

Правда, mm.